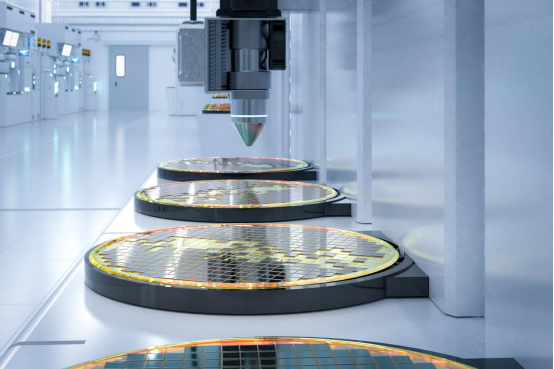

当全球目光被三星、SK海力士和美光在HBM领域的争夺所吸引时,一场静默却更具颠覆性的变革正在发生:微软、高通等巨头,正将原本属于智能手机的LPDDR内存,部署进AI数据中心的核心。

这揭示了一个被忽视的真相:在AI普及的道路上,DDR与LPDDR代表的“高能效内存”路线,其市场潜力远比HBM广阔得多。内存战争的决胜点,已从“性能巅峰”转向“效率与成本的精妙平衡”。

巨头的选择:为什么是LPDDR?

微软与高通选择LPDDR,是基于极致理性的商业计算。评判标准已从纸面算力,变为 “每Token成本” ——处理每次AI请求的综合成本。

AI数据中心是“电老虎”,内存功耗占系统总功耗可达30%以上。LPDDR天生的低功耗特性,在百万服务器规模下,能带来数亿美元级的电费节省。LPDDR可通过先进封装与AI芯片紧耦合,实现“近存计算”。这打破了传统架构限制,让单台服务器成为高密度“算力集装箱”,显著提升数据中心空间利用率,降低基建与运维成本。LPDDR有着成熟的移动生态和巨大出货量,拥有无可比拟的成本优势。在满足性能需求后,极致的“每GB成本”和“每焦耳带宽”成为规模化推理服务的决胜关键。

主战场:推理市场的万亿舞台

AI产业重心正从“模型创造”(训练)转向 “服务交付”(推理) 。据OpenAI等机构估计,未来超过80%的AI算力支出将发生在推理端。这个市场特征鲜明:成本敏感、能效为王、场景碎片化。

这正是DDR5和LPDDR5X的绝对主场:DDR5作为通用服务器基石,凭借性能、容量与成本的黄金平衡,将成为主流云端推理的支柱。LPDDR5X则凭极致能效和封装灵活性,成为定制AI芯片及高端边缘设备的首选。

行业巨头共同塑造效率革命

在AI数据中心的“效率革命”中,产业巨头正依据各自优势,共同塑造下一代算力的价值标准。

微软作为顶层云服务与AI应用的引领者,其自研芯片采用LPDDR的决策,实质上是为整个产业定义了新标杆:极致“每Token成本” 是未来数据中心的核心追求。

高通则以专用芯片设计者的角色迅速响应,在其AI200等推理加速器中集成大容量LPDDR,将前沿架构理念转化为可交付的高效硬件方案,提供了传统GPU之外的重要选择。

而长鑫存储作为关键的DRAM提供商,于2025年底推出的高速率DDR5(8000Mbps)与高能效LPDDR5X(10667Mbps),恰好为这场变革提供了性能达标、供应可靠且成本更具竞争力的核心内存解决方案。

无论是微软、高通作为算力需求方的转向,还是长鑫存储的产品性能演进路线,这些行动都清晰地预示:内存竞争的焦点已从HBM的性能之巅,转向DDR/LPDDR的效率平原。胜负不再取决于峰值速度,而在于谁能以最高的能效与最低的综合成本,稳定支撑全球AI服务的每一秒推理。

这标志着AI竞争进入规模化与商业化的“精算”阶段。赢得这片更广阔效率市场的企业,将主导AI算力普及的未来格局。