名为OpenClaw的开源AI智能体,凭借可爱的“龙虾”标识火速走红,成为2026年开年全球开源社区热度登顶的现象级产品。和只能被动对话的传统AI截然不同,这款智能体在获得权限后,能够自主调用电脑端各类软件执行实操任务,邮件管理、代码编写、内容创作、文件清理等工作都能高效完成,早已跳出普通聊天机器人的范畴,化身能够替代人工处理重复性繁杂工作的专属“数字员工”,彻底改写了AI的应用形态。

这场席卷全球的“龙虾AI”狂欢快速蔓延,不少嗅到AI商机的爱好者,率先在各大社交平台推出OpenClaw代安装服务,收费区间从几十元到几百元不等,一度成为热门小众生意。但热闹的表象之下,用户端的实际使用痛点接连暴露:当AI聊天、智能翻译、语音转写等多款AI应用同步运行时,电脑加载速度大幅变慢、手机操作频繁卡顿,原本丝滑的设备使用体验大打折扣,彻底打破了大家对AI智能体的美好预期。

算力需求爆发,内存成核心瓶颈

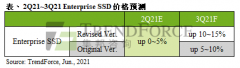

这一系列卡顿问题的根源,藏着一个被大众忽略的核心逻辑:AI智能体与传统AI应用的资源消耗,完全不在一个量级。传统AI对话仅需消耗几百个Token,而OpenClaw这类自主执行型智能体,要完成任务拆分、联网检索、软件调用、纠错重试等一整套闭环操作,Token消耗量呈指数级增长,重度用户单日Token消耗甚至能达到3000万到1亿个。Token消耗的爆发式增长,直接催生了近乎无限的算力需求,而这种飞速飙升的算力诉求,最终都要依托高性能内存作为核心支撑,才能顺利落地。

实际体验过AI智能体的用户都深有体会,它堪称远超普通APP的“内存吞噬者”。比如同时下达整理会议纪要、检索相关文献、生成PPT大纲三项指令,智能体需要实时调用大模型、缓存海量数据、同步多个任务进程,对内存的带宽和容量要求直接翻倍。相关数据显示,运行一款中等复杂度的AI智能体,仅后台缓存就会占用3-5GB内存,再叠加系统运行和其他常驻APP,即便是搭载16GB内存的设备,也极易出现内存溢出问题,进而引发卡顿、闪退、无响应等故障。

这也意味着,步入AI智能体全面落地的时代,内存正式成为决定设备性能的核心要素:内存带宽直接决定AI数据的处理传输速度,内存容量则关乎多任务并行的运行稳定性。大模型的核心参数必须加载到计算单元附近的高速存储模块,才能实现快速调取使用,如今制约整体算力发挥的核心瓶颈,早已从处理器性能,转变为数据从内存传输到计算核心的速率。

终端硬件升级,适配AI新需求

针对PC端AI重载场景的严苛需求,DDR5内存成为适配这类场景的最优解决方案。想要让AI绘图、视频剪辑、智能体多任务并行等重负载操作流畅运行,实现内存与处理器之间的高速数据传输,DDR5内存是不可或缺的核心硬件。长鑫科技去年年底推出的DDR5内存,最高速率可达8000Mbps,单颗颗粒容量达到24Gb,还能组建48GB、96GB的超大容量内存条,完全是为OpenClaw这类高耗算力智能体量身高定,能够轻松支撑多款AI智能体同步运行,彻底帮用户摆脱关闭APP腾出内存的纠结烦恼。

转向手机端,运行AI智能体不仅需要极致的响应速度,还要解决长时间使用的续航焦虑,因此内存配置必须升级为LPDDR5X规格。长鑫科技去年实现发布的LPDDR5X内存,最高速率高达10667Mbps,单颗颗粒容量16Gb,功耗相比上一代产品直接降低30%,完美契合手机端AI应用的核心诉求:既能保障语音助手实时翻译、AI相册智能分类、智能体后台运行等功能零延迟,又能避免AI运行带来的电量快速损耗,称得上是为移动端AI应用专属打造的核心配置。

其实各大终端设备厂商早已预判到AI智能体的爆发趋势,CPU、内存等核心硬件厂商也提前布局,完成了多轮性能升级与技术储备。OpenClaw的爆火绝非偶然,而是AI智能体全面渗透日常办公、学习、娱乐等各类场景的明确信号。随着越来越多实用型AI智能体走进大众生活,这场由AI智能体引领的科技变革已然到来,高性能硬件加持的全新智能时代,正全面拉开帷幕。